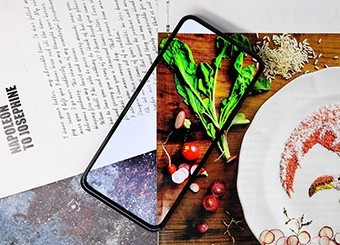

这短短5秒的视频在制作精细度上远超常规水平。无论是在光影变化、色彩搭配、画面构图,还是人物面部细微表情的刻画上,通义万相2.2均展现出接近专业影视制作的标准,呈现出高度真实的视觉质感。

本次开源共发布了三款模型:文本生成视频(Wan2.2-T2V-A14B)、图像生成视频(Wan2.2-I2V-A14B)以及统一视频生成模型(Wan2.2-TI2V-5B)。其中,文本生成视频与图像生成视频模型采用了业界首次应用的MoE(混合专家)架构,模型总参数量达270亿,激活参数为140亿。

该架构通过高噪声专家模型与低噪声专家模型的协同运作实现高效生成。高噪声专家负责构建视频的整体结构与动态布局,低噪声专家则专注于细节优化,如纹理清晰度、动作连贯性等。两者分工明确、配合紧密,在相同参数规模下,可减少约50%的计算资源消耗,显著提升生成效率。

此外,通义万相2.2还引入了创新的电影美学控制机制。该系统能够像专业导演一样,对视频中的美学要素进行系统性调控。无论是打造节奏紧凑、气氛紧张的动作场面,还是呈现柔和细腻、富有诗意的情感片段,系统均可通过对光影层次、色调搭配和画面构图的智能调节,赋予视频更强的艺术表现力和电影质感。

此次全面开源,意味着更多创作者、技术开发者及普通用户将能够便捷地使用这一先进工具,低门槛地参与到高质量视频内容的创作中,进一步推动视觉内容生成技术的普及与创新。

本文属于原创文章,如若转载,请注明来源:通义万相2.2开源:电影级视频生成新突破https://dcdv.zol.com.cn/1021/10219908.html